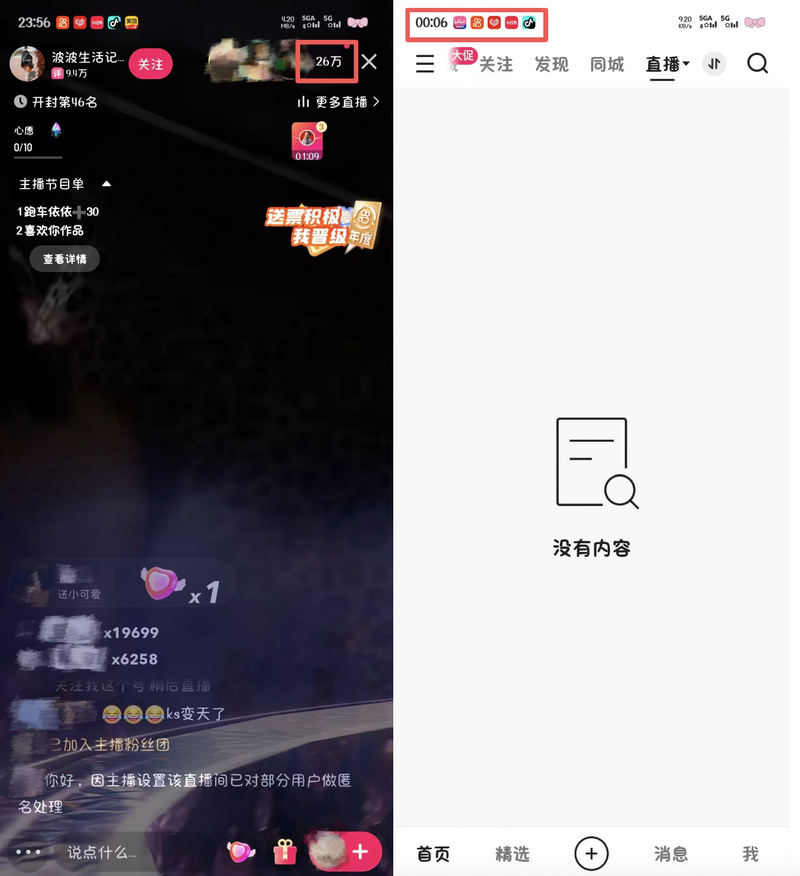

黑灰色的攻击抓住了快手。 “快手直播间出事了。” 12月22日午夜左右,类似消息在网络上流传,大批网友在不了解详情的情况下涌入快手直播间“吃瓜”。有网友告诉贝壳财经记者,不到一分钟就看到了“传奇内容”,赶紧关闭了直播间。几乎同一时间,电商直播被迫中断。全平台直播宕机,直播间一片寂静。 23日凌晨,贝壳财经记者从快手获悉,该平台于22日22:00左右遭到黑灰产品攻击,并立即修复。 “平台坚决打击违法内容,相应情况已向相关部门预判并向公安机关报案。” F据记者采访获得的信息,从遭受攻击到平台决定“拔掉插头”,大约花了两个小时。为什么黑灰攻击的拦截时间长达两个小时?一位网络安全专家告诉贝壳财经记者,一般情况下,平台通常都会有低俗、色情、暴力等视频筛查服务,一旦违法内容集中出现,智能视频分析的并发投入可能不够大,分析能力可能无法实时完成,造成失控。企业做出关闭直播的决定也需要时间 自从快手按下“急刹车”,互联网热度持续走高。苹果应用商店截图显示,截至12月23日中午,快手在免费App(应用程序)排行榜中已升至第二位,快手快捷版在第 15 位。 12月23日中午,快手重新发布公告称,App直播功能已逐步恢复正常,其他服务不受影响。但资本市场依然用脚投票。截至发稿,快手W报64.35港元/股,下跌3.52%。有人经历过这种“失控的两个小时”吗?黑灰攻击如何发现漏洞?平台应如何从源头上强化防线?一名用户目睹了色情内容的直播,持续时间不到一分钟。在线人数达到26万人。 “快手直播间出事了。” 12月22日23点54分左右,朋友的一条消息让平时不看快手的网友点击了快手App。直播界面推荐的第一个直播间让他目睹了不到一分钟的色情内容直播,然后场景突然停止了。该网友提供的截图中可以看到,截至23时56分,直播间在线人数已达26万。随后直播间就关闭了。 23日零点六分左右,他再次点击快手直播页面,页面显示“无内容”。受访者提供的截图显示,当时直播间内有26万人。这场风暴还通过了直播主播。当一名快手电商商家向记者讲述自己的经历时,他表示,当时并不知道平台遭到攻击。 “我们的直播在12点左右就中断了,立刻就被下载了。由于直播内容无法在所有平台上上传,我们认为这种情况是平台的普遍问题,所以没有向云汇报。”营地内反馈。此外,快手某电商商家的动态直播页面显示,其进行了一次22日20时29分至23时22分直播,22日23时34分至23日0时9分再次直播。两场直播都在短时间内中断。该平台发现自己被黑了。被强行撕毁,引发热议。社交媒体上的网民。甚至有传言称,非法直播间隐藏着病毒链接。很多用户点击后,微信账号被盗,不法分子立即向该账号上的好友发送贷款请求进行诈骗。对此,微信23日上午11时08分回应称,上述信息经查实不实。微信帐号有严格的安全保护机制。目前尚未发现相关问题,也未收到类似反馈。快手发表声明。其表示,快手应用的直播功能逐渐恢复正常服务,其他服务未受影响。舆论持续发酵。截至23日中午此前,快手曾一度升至苹果App Store免费应用排行榜第二名,而且是老对手字节产品。第一名是。豆宝,第三名是红果短剧。 23日中午,记者查看苹果商店页面发现,快手在免费应用排行榜中排名第二,快手快递版排名第15。这反映出快手黑灰攻击引发的公众网络安全担忧。根据国家网信办今年9月公布的《国家网络安全事件报告管理办法》,地市级以上党政机关、企事业单位门户网站以及省级以上重大新闻。网站、大型网络平台等遭到攻击、篡改,导致违法有害信息广泛传播。可以考虑以下情况之一被认定为“广泛传播”的:(一)出现在首页且持续时间超过2小时,或者出现在其他页面且持续时间超过12小时的; (2)通过社交媒体。平台转发量已超过10000次; (三)浏览或者点击次数超过10万次; (四)省级以上网信部门、公安机关认为“普遍存在”的。 “从目前收到的信息来看,(快手)极有可能主要是被黑灰产品用来直播,数以万计的账号同时直播,占用‘视频AI审核’的算力,造成直播内容审核系统大量排队甚至瘫痪,这应该是实施本次攻击的唯一途径。”网络安全专家曲龙向贝壳财经记者解释道。 “很多人反映,由于快手的问题,很多新账号开始直播。但是,目前尚未确定是否可以通过手机号码注册、无需实名认证的方式开始直播,或者是否在技术上绕过实名认证,导致该群的控制用户直接开始直播。 ”一位网络安全行业人士透露。从业人员可能的攻击起点:海量账号注册。黑灰产品可以在拥有大量手机SIM卡的“猫池”中,几秒内注册上万个僵尸账号。这些僵尸账号被注册为平台账号,然后通过自动化na脚本模仿真实用户行为,比如在网页上翻页、点赞等,会绕过平台的风控模型,误认为平台是真实用户。如果用户的IP地址敏感,或者用户有使用脏话等异常行为,平台会关注2小时左右。自从快手宣布受到攻击,“封锁”平台上所有直播内容。其背后的原因是,计算能力可能无法支持同时分析大量非法内容,并且内部决策需要时间。显然,当晚防御机制的日常运行遭遇了严峻的压力考验。 “这背后是计算能力无法支持大量非法内容的并发分析,以及内部重大决策所需的时间。”曲龙解释道。他详细分解了平台的日常审核逻辑:正常情况下,平台通常会针对低俗、色情、暴力等视频内容提供针对性的视频审核服务。一般是智能AI先审核,识别准确的直接屏蔽。有任何疑问或问题,将转发给客服审核w。相比于实时视频流,平台将视频流按一定时间进行切割,然后将结果返回给它。他补充说,在平台正常运行且没有太多低俗色情内容的情况下,上述工作流程可以正常运行。一旦违法内容集中出现,原本准备的智能视频审核云投入的兼容性就不够大,需要审核的内容群同时奔向智能AI审核任务。导致审核能力无法实时完成,出现排队、拥堵,审核人员在直播出现问题时无法直接快速向业务反馈。商家自然不知道哪个直播间出了问题,哪个直播间需要关闭。 “即使业务发现了集中化的情况,对于大公司来说,从发现到出现集中化的情况需要一段时间也是很正常的。围绕问题和拓展“渠道”进行业务分析,直到发现涉及的直播间太多,完全失控,然后向高层汇报计划,直接关闭整个直播间。停止直播间每分钟都是重大事故,这种经济决策不可能每分钟都直接做出。他说。企业网络安全事件后,谣言不断,值得深思。平台应如何从源头上强化防线?前述网络安全从业者认为,针对大量新账户同时上线等异常场景,平台需要提高风险评估机制的灵敏度,并有更及时的中断推送机制。另外,短时间内注册大量新账户的场景也需要一定的风险控制。驱龙提议d 一个更基本的身份验证思想。抛开劫持问题,平台账户认证问题的最佳解决方案是不信任用户的“之前的认证状态”,在直播前再次检查人脸识别,检查实名信息是否与直播者相符。 “这相当于签订了一份‘电子合同’,如果直播间出现违法违规行为,如果不是平台技术漏洞造成的,就应该是用户自身的违法问题。”对于批量攻击占用审计资源的问题,他表示,一是加强上限计算活动,二是设置直播门槛。每个账号在开播前都需要进行实名认证的身份比对和人脸验证,这对于黑灰产品显然是有约束力的。下一次洪水来临时,堤坝会被淹没吗?建造得更高、更智能?新京报贝壳财经记者魏英姿罗一丹编辑陈莉校对刘宝庆

黑灰色的攻击抓住了快手。 “快手直播间出事了。” 12月22日午夜左右,类似消息在网络上流传,大批网友在不了解详情的情况下涌入快手直播间“吃瓜”。有网友告诉贝壳财经记者,不到一分钟就看到了“传奇内容”,赶紧关闭了直播间。几乎同一时间,电商直播被迫中断。全平台直播宕机,直播间一片寂静。 23日凌晨,贝壳财经记者从快手获悉,该平台于22日22:00左右遭到黑灰产品攻击,并立即修复。 “平台坚决打击违法内容,相应情况已向相关部门预判并向公安机关报案。” F据记者采访获得的信息,从遭受攻击到平台决定“拔掉插头”,大约花了两个小时。为什么黑灰攻击的拦截时间长达两个小时?一位网络安全专家告诉贝壳财经记者,一般情况下,平台通常都会有低俗、色情、暴力等视频筛查服务,一旦违法内容集中出现,智能视频分析的并发投入可能不够大,分析能力可能无法实时完成,造成失控。企业做出关闭直播的决定也需要时间 自从快手按下“急刹车”,互联网热度持续走高。苹果应用商店截图显示,截至12月23日中午,快手在免费App(应用程序)排行榜中已升至第二位,快手快捷版在第 15 位。 12月23日中午,快手重新发布公告称,App直播功能已逐步恢复正常,其他服务不受影响。但资本市场依然用脚投票。截至发稿,快手W报64.35港元/股,下跌3.52%。有人经历过这种“失控的两个小时”吗?黑灰攻击如何发现漏洞?平台应如何从源头上强化防线?一名用户目睹了色情内容的直播,持续时间不到一分钟。在线人数达到26万人。 “快手直播间出事了。” 12月22日23点54分左右,朋友的一条消息让平时不看快手的网友点击了快手App。直播界面推荐的第一个直播间让他目睹了不到一分钟的色情内容直播,然后场景突然停止了。该网友提供的截图中可以看到,截至23时56分,直播间在线人数已达26万。随后直播间就关闭了。 23日零点六分左右,他再次点击快手直播页面,页面显示“无内容”。受访者提供的截图显示,当时直播间内有26万人。这场风暴还通过了直播主播。当一名快手电商商家向记者讲述自己的经历时,他表示,当时并不知道平台遭到攻击。 “我们的直播在12点左右就中断了,立刻就被下载了。由于直播内容无法在所有平台上上传,我们认为这种情况是平台的普遍问题,所以没有向云汇报。”营地内反馈。此外,快手某电商商家的动态直播页面显示,其进行了一次22日20时29分至23时22分直播,22日23时34分至23日0时9分再次直播。两场直播都在短时间内中断。该平台发现自己被黑了。被强行撕毁,引发热议。社交媒体上的网民。甚至有传言称,非法直播间隐藏着病毒链接。很多用户点击后,微信账号被盗,不法分子立即向该账号上的好友发送贷款请求进行诈骗。对此,微信23日上午11时08分回应称,上述信息经查实不实。微信帐号有严格的安全保护机制。目前尚未发现相关问题,也未收到类似反馈。快手发表声明。其表示,快手应用的直播功能逐渐恢复正常服务,其他服务未受影响。舆论持续发酵。截至23日中午此前,快手曾一度升至苹果App Store免费应用排行榜第二名,而且是老对手字节产品。第一名是。豆宝,第三名是红果短剧。 23日中午,记者查看苹果商店页面发现,快手在免费应用排行榜中排名第二,快手快递版排名第15。这反映出快手黑灰攻击引发的公众网络安全担忧。根据国家网信办今年9月公布的《国家网络安全事件报告管理办法》,地市级以上党政机关、企事业单位门户网站以及省级以上重大新闻。网站、大型网络平台等遭到攻击、篡改,导致违法有害信息广泛传播。可以考虑以下情况之一被认定为“广泛传播”的:(一)出现在首页且持续时间超过2小时,或者出现在其他页面且持续时间超过12小时的; (2)通过社交媒体。平台转发量已超过10000次; (三)浏览或者点击次数超过10万次; (四)省级以上网信部门、公安机关认为“普遍存在”的。 “从目前收到的信息来看,(快手)极有可能主要是被黑灰产品用来直播,数以万计的账号同时直播,占用‘视频AI审核’的算力,造成直播内容审核系统大量排队甚至瘫痪,这应该是实施本次攻击的唯一途径。”网络安全专家曲龙向贝壳财经记者解释道。 “很多人反映,由于快手的问题,很多新账号开始直播。但是,目前尚未确定是否可以通过手机号码注册、无需实名认证的方式开始直播,或者是否在技术上绕过实名认证,导致该群的控制用户直接开始直播。 ”一位网络安全行业人士透露。从业人员可能的攻击起点:海量账号注册。黑灰产品可以在拥有大量手机SIM卡的“猫池”中,几秒内注册上万个僵尸账号。这些僵尸账号被注册为平台账号,然后通过自动化na脚本模仿真实用户行为,比如在网页上翻页、点赞等,会绕过平台的风控模型,误认为平台是真实用户。如果用户的IP地址敏感,或者用户有使用脏话等异常行为,平台会关注2小时左右。自从快手宣布受到攻击,“封锁”平台上所有直播内容。其背后的原因是,计算能力可能无法支持同时分析大量非法内容,并且内部决策需要时间。显然,当晚防御机制的日常运行遭遇了严峻的压力考验。 “这背后是计算能力无法支持大量非法内容的并发分析,以及内部重大决策所需的时间。”曲龙解释道。他详细分解了平台的日常审核逻辑:正常情况下,平台通常会针对低俗、色情、暴力等视频内容提供针对性的视频审核服务。一般是智能AI先审核,识别准确的直接屏蔽。有任何疑问或问题,将转发给客服审核w。相比于实时视频流,平台将视频流按一定时间进行切割,然后将结果返回给它。他补充说,在平台正常运行且没有太多低俗色情内容的情况下,上述工作流程可以正常运行。一旦违法内容集中出现,原本准备的智能视频审核云投入的兼容性就不够大,需要审核的内容群同时奔向智能AI审核任务。导致审核能力无法实时完成,出现排队、拥堵,审核人员在直播出现问题时无法直接快速向业务反馈。商家自然不知道哪个直播间出了问题,哪个直播间需要关闭。 “即使业务发现了集中化的情况,对于大公司来说,从发现到出现集中化的情况需要一段时间也是很正常的。围绕问题和拓展“渠道”进行业务分析,直到发现涉及的直播间太多,完全失控,然后向高层汇报计划,直接关闭整个直播间。停止直播间每分钟都是重大事故,这种经济决策不可能每分钟都直接做出。他说。企业网络安全事件后,谣言不断,值得深思。平台应如何从源头上强化防线?前述网络安全从业者认为,针对大量新账户同时上线等异常场景,平台需要提高风险评估机制的灵敏度,并有更及时的中断推送机制。另外,短时间内注册大量新账户的场景也需要一定的风险控制。驱龙提议d 一个更基本的身份验证思想。抛开劫持问题,平台账户认证问题的最佳解决方案是不信任用户的“之前的认证状态”,在直播前再次检查人脸识别,检查实名信息是否与直播者相符。 “这相当于签订了一份‘电子合同’,如果直播间出现违法违规行为,如果不是平台技术漏洞造成的,就应该是用户自身的违法问题。”对于批量攻击占用审计资源的问题,他表示,一是加强上限计算活动,二是设置直播门槛。每个账号在开播前都需要进行实名认证的身份比对和人脸验证,这对于黑灰产品显然是有约束力的。下一次洪水来临时,堤坝会被淹没吗?建造得更高、更智能?新京报贝壳财经记者魏英姿罗一丹编辑陈莉校对刘宝庆